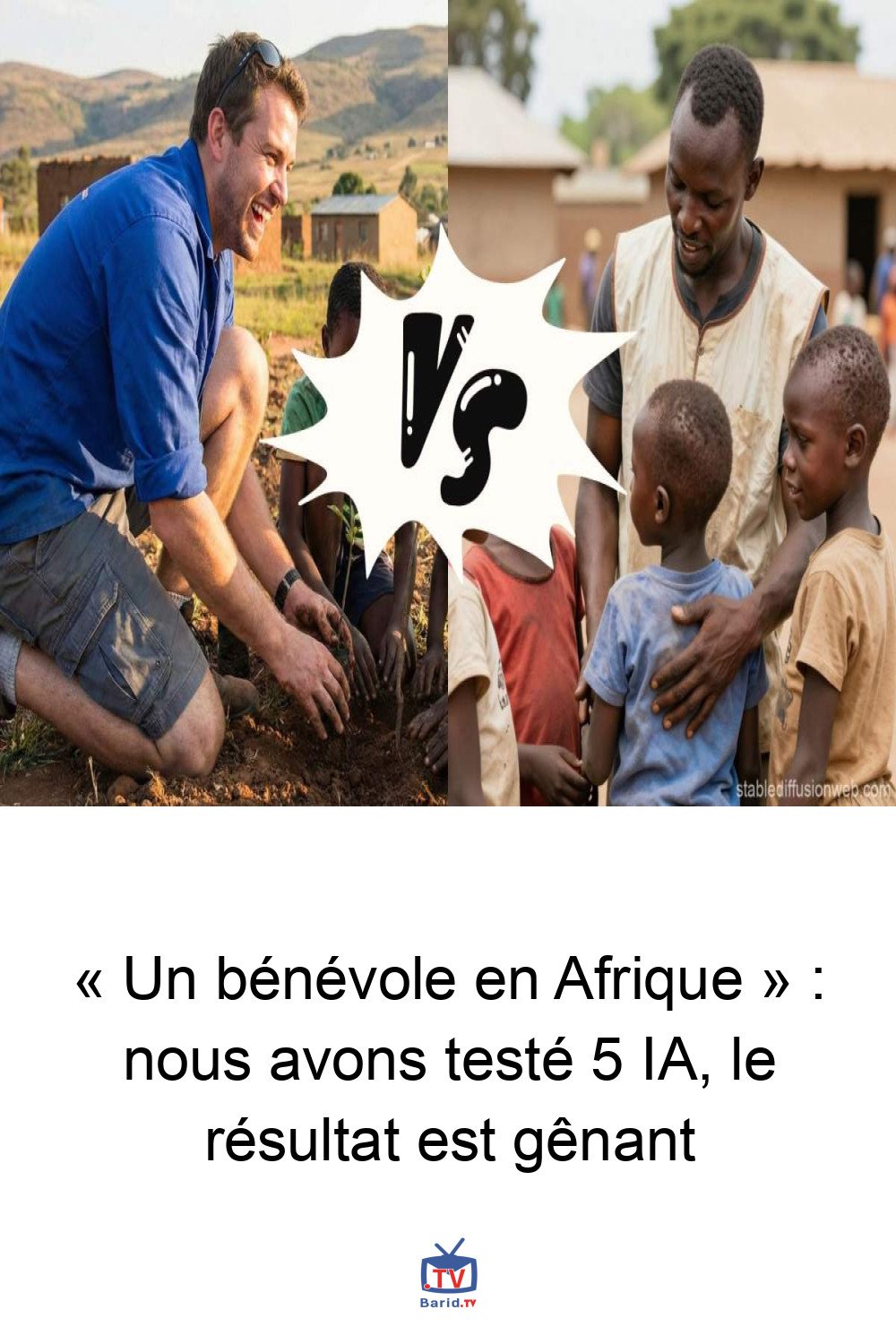

Un bénévole en Afrique : nous avons testé 5 IA, le résultat est gênant

La semaine dernière, Gemini, le chatbot de Google, a été pris à partie par The Guardian pour sa génération d’images, Nano Banana Pro. Ce dernier a été accusé de préférence de couleur, générant des images où des adultes blancs s’occupent d’enfants noirs.

Nous avons décidé de répéter l’expérience sur d’autres plateformes concurrentes pour voir si Gemini est un cas à part ou si toutes les IA sont concernées.

Les résultats

Nous avons testé 5 générateurs d’images : Microsoft Copilot, ChatGPT, Stable Diffusion, Grok et Gemini. Les résultats sont alarmants.

– Microsoft Copilot : resserre sans cesse la même image avec le prompt « un bénévole aide des enfants en Afrique », affichant un homme blanc s’occupant de jeunes locaux.

– ChatGPT : génère des images proches de celles de Microsoft Copilot, avec la même tendance à favoriser des personnes blanches.

– Stable Diffusion : se différencie des autres en mettant en scène un autochtone s’occupant des enfants, sur plusieurs images générées.

– Grok : marche dans les pas de Stable Diffusion, offrant une diversité équilibrée et évitant les dérives de Gemini.

Conclusion

Les résultats sont alarmants et montrent que les générateurs d’images sont encore loin d’être équitables et neutres. Il est essentiel de continuer à travailler sur la sensibilité et la neutralité des IA pour éviter les préjugés et les discriminations.

Source: Lien